Abstrakt

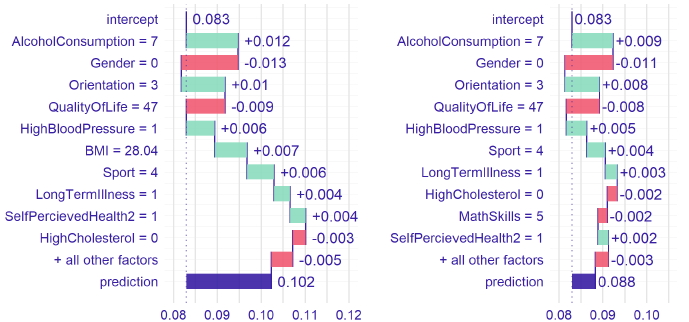

Machine Learning (ML) models are often complex and difficult to interpret due to their “black-box” characteristics. Interpretability of a ML model is usually defined as the degree to which a human can understand the cause of decisions reached by a ML model. Interpretability is of extremely high importance in many fields of healthcare due to high levels of risk related to decisions based on ML models. Calibration of the ML model outputs is another issue often overlooked in the application of ML models in practice. This paper represents an early work in examination of prediction model calibration impact on the interpretability of the results. We present a use case of a patient in diabetes screening prediction scenario and visualize results using three different techniques to demonstrate the differences between calibrated and uncalibrated regularized regression model.

Publikacija

In DSHealth 2020: 2020 KDD Workshop on Applied Data Science for Healthcare: Trustable and Actionable AI for Healthcare, August 24, San Diego, CA, United States

Doktorski študent

Moji raziskovalni interesi vključujejo statistične modele in metode strojnega učenja z aplikacijami v zdravstvu. Specifična področja, ki me zanimajo, vključujejo časovno analizo podatkov, interpretacijo napovednih modelov, stabilnost algoritmov, napredne metode strojnega učenja na masivnih podatkovjih, npr. globoke nevronske mreže.

Doktorantka

Moji raziskovalni interesi vključujejo področje duševnega zdravja, raziskovanje v zdravstveni negi in informatika v zdravstvu. Specifična področja, ki me zanimajo, vključujejo duševno zdravje mladostnikov, psihometično testiranje vprašalnikov, lokalizacijo vprašalnikov ter kvantitativno analizo podatkov.

Izredni profesor in predstojnik raziskovalnega inštituta

Moji raziskovalni interesi vključujejo tehnike strojnega učenja z uporabo v zdravstvu. Specifična področja, ki me zanimajo, vključujejo razumljivost napovednih modelov, klasifikacija, ki temelji na človeški interakciji, stabilnost algoritmov za izbiro lastnosti, meta učenje in odkrivanje longitudinalnih pravil.

Image credit: ACM

Image credit: ACM